ミニ特集「知能システム学の博士論文」A Study on Recognition of Students’ Multiple Mental States during Discussion Using Multimodal Data(マルチモーダルデータを用いた議論中の学生の心的状態の認識に関する研究)(Shimeng Peng)

知能システム学専攻教授 長尾 確

ディスカッション活動中、学生たちは複雑な精神状態を経験します。これは、学生の学習状況を明らかにするための重要な要素と広く認識されています。理想的な教師は、学生の精神状態を学習中に監視し、学生が抱える学習の悩みを推測し、どのタイミングでどのような支援を行うかをリアルタイムで決定できるべきです。多くの研究では、コンピュータ環境で事前設計された学習タスクにおいて、学生の単一の精神状態を自動的に測定する方法が探求されています。しかし、実際の教師と学生のインタラクティブなディスカッション活動の現実の環境で、複数の学生の複雑な精神状態を監視することは依然として課題です。

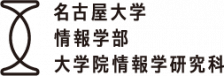

この研究では、ディスカッション中の学生の複数の精神状態を効果的に監視するために、教師を支援するインテリジェント監視エージェント(図1)を設計するために、マルチモーダルデータを使用することを提案します。

図1 インテリジェント監視エージェント

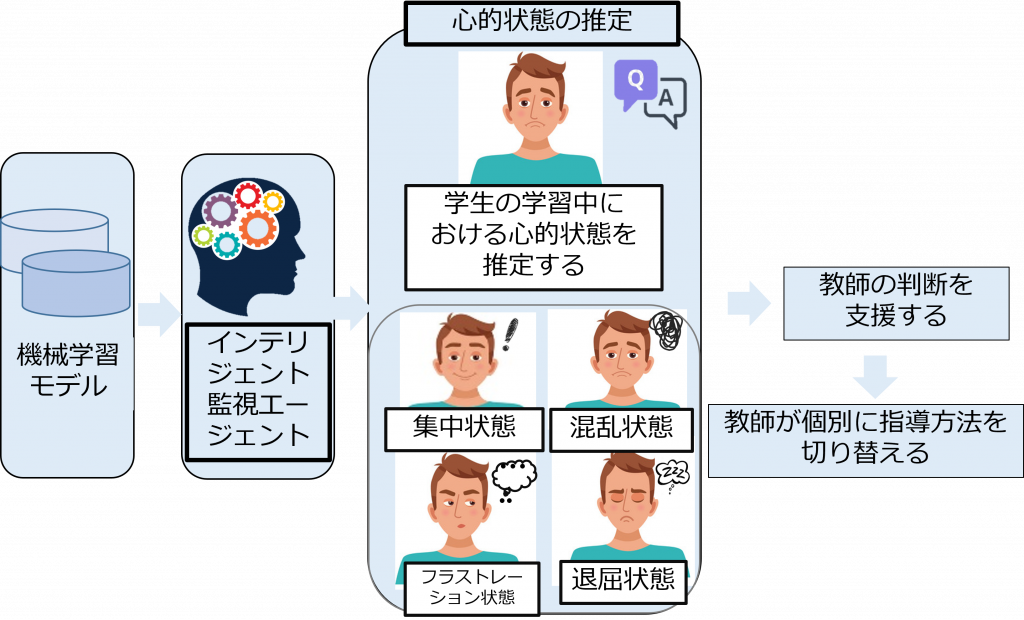

この目標を達成するために、高度なマルチセンサーベースのデータ収集システムが開発され、実際の大学の研究室で適用され、現場でのマルチモーダル会話データを大量に記録・蓄積しました。まず、ディスカッションのQ&Aセッションで学生の自信を自動的に認識するために、学生の心拍数の生理学的手がかりの予測能力を検証するために、探索的な作業が行われました。次に、顔、心拍数、音響モダリティから特徴を導出し、それらを使用していくつかの監督学習分類器を複数のマルチモーダル統合アプローチ(単一モダリティレベル、特徴レベル、決定レベルで統合する)で訓練し、会話中の生徒の複数の精神状態を認識するために、どのように効果的にマルチモーダル分析を設計するかをさらに探求しました(図2)。

(注)「モダリティ」とは、情報を表現・伝達するために使用される様々な様式(あるいは媒体)を指します。マルチモーダルデータは、複数のモダリティから取得された情報を組み合わせたデータです。

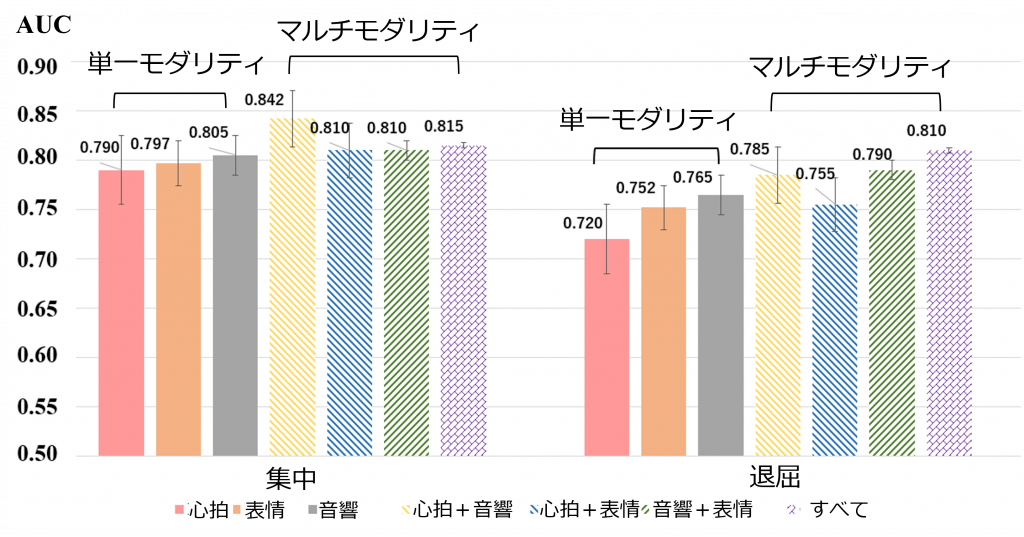

図2 システム構成

異なる精神状態を認識する能力を向上させるために、効果的なマルチモーダル分析の設計を検討しました。心拍数と音響モダリティを統合することで、集中状態(AUC = 0.842)と混乱状態(AUC = 0.695)をより良く認識することができ、3つのモダリティを統合することで、フラストレーション状態(AUC = 0.737)と退屈状態(AUC = 0.810)を最も良く認識することができました(図3)。また、この結果は、異なるモダリティ間の置換機能の利点を活用して、実際の教育環境で学生を監視する際の課題に対処するための教師向けソリューションを提供する可能性も探求しました。

(注)「AUC」はArea Under the Curve(曲線下の面積)の略で、分類器の性能を評価するために使用される指標です。AUCは主に、ROCカーブの下の面積を指します。ROCカーブは、横軸に偽陽性率を、縦軸に真陽性率をとったグラフで、分類器の性能を視覚的に表現します。AUCは0から1の範囲で表され、値が1に近いほど、分類器の性能が良いことを示します。

図3 実験結果

要するに、この研究ではマルチモーダルデータを用いて、ディスカッション中の学生の複数の精神状態を効果的に監視するインテリジェント監視エージェントを設計することを提案しました。これにより、教師の知覚や推論能力を向上させることができ、実際の教育環境での学生の監視に対処するための解決策が提供されました。これは、ディスカッション活動中の学生の精神状態をより効果的に理解し、適切なサポートを提供することができる教育環境を実現するための重要な一歩です。