ミニ特集「知能システム学の博士論文」Speech Emotion Recognition in Real Environments using Characteristics of Emotional Expression and Perception(感情の表出・知覚特性を利用した実環境における音声感情認識)(Atsushi Ando)

情報基盤センター/知能システム学専攻教授 戸田 智基

人間のコミュニケーションの最も基本的で重要な形式の一つが音声です。音声には、言語的な要素、非言語的な要素(性別、年齢、感情など、意識的にはコントロールできないもの)、そしてパラ言語的な情報(意図や態度のように、意識的にコントロールできるもの)の主に3つの要素が含まれます。人間と機械との間での音声によるコミュニケーションを実現するために、言語情報の認識、つまり自動音声認識について多くの研究が行われてきました。最近では、人間と同じように音声を理解し、より自然なコミュニケーションを実現するために、非言語情報やパラ言語情報の認識に関する研究が注目を集めています。この博士論文では、非言語情報の重要な要素の一つである話者の感情の認識に焦点を当てています。

感情は音声コミュニケーションにおいて重要な役割を果たします。言語的な内容や態度といった多種多様な音声の特徴は感情の影響を受けます。そのため、音声コミュニケーションを理解するためには、感情の認識が不可欠です。感情の認識は、ユーザー支援エージェントや「顧客の声」の分析、話者の感情に共感する人間のような音声対話システム、運転者のイライラ感などの人間の心理状態の検出など、多くの実用的な応用例があります。

これまでに数多くの感情認識の研究が行われてきましたが、実際の環境に適用させる上で2つの大きな問題があります。まず、感情の表現は非常に複雑で多様です。話者の感情は、抑揚、言語的特徴、対話的特徴のいずれか、さらにはその組み合わせによって表現されます。例えば、否定的な感情は低い声の調子、否定的な言葉、長い間の休止、または少ない相槌に現れることがあります。これらすべての特徴を捉えて感情を認識することは非常に困難です。次に、感情は聞き手に強く影響を受ける主観的な情報です。感情を感じる基準は、聞き手によって異なる場合があります。たとえば、ある発言について、ある聞き手は話者が幸せに感じていると感じる一方で、他の聞き手は話者が普通の状態にいると感じるかもしれません。しかし、従来の感情認識の研究では、この聞き手の依存性を無視し、複数の聞き手の多数派の感情を推定するだけでした。これが、自動感情認識システムによる推定結果と実際のアプリケーションでのユーザーの感情との間にミスマッチを生じさせる要因となります。

実環境での高精度な感情認識を達成するために、この博士論文では二段階の研究を行います。第一段階の研究では、実環境ではありますが限定的な状況下における特定の感情の検出に取り組みます。対象とする感情や状況を制約することで、最初の問題である感情的な手がかりの多様性が緩和され、認識精度が実用的なレベルにまで引き上げられます。さらに、これらの制約により、聞き手間の感情の認識の違いも減少します。第二段階の研究では、多様な実世界環境での広範な感情の認識に取り組みます。聞き手間で感じる感情の違いが大きくなるため、第二の問題を解決することを目指します。

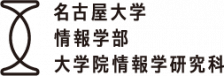

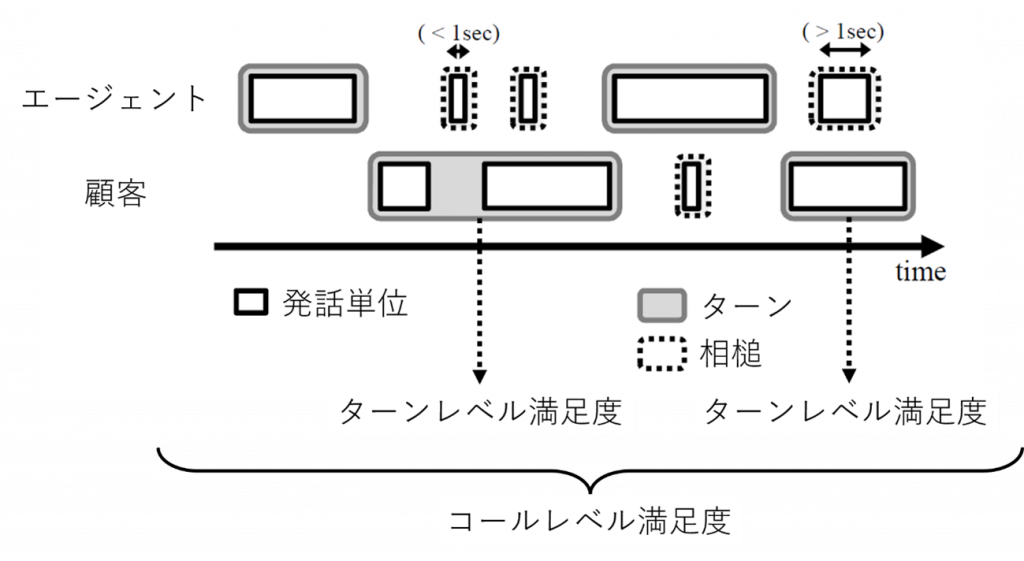

第一段階の研究課題として、コンタクトセンターの通話での顧客満足度の推定に取り組みます。これは、エージェント評価の自動化に応用できます。このタスクでは、ターンレベルとコールレベルといった2つのレベルの顧客満足度が推定されます(図1参照)。主な問題は、抑揚、言語的な手がかり、対話的な手がかりに現れる複雑な感情表現を捉えることが困難であるということです。この問題を解決するために、新しい顧客満足度推定フレームワークとして「階層的マルチタスク学習モデル」を提案します。この提案手法の鍵となる考え方は、顧客の感情表現の2つの特性を活用することです。まず、顧客の満足度は文脈に依存します。例えば、不満な感情状態は何度も続く傾向がありますが、満足した感情状態はそうではありません。また、コールレベルとターンレベルの満足度結果は互いに密接に関連しています。コールレベルの満足度が満たされている通話では、通話の中盤と終盤で満足度が高いターンが見られる傾向があります。提案するモデルでは、再帰型ニューラルネットワークと、二階層の顧客満足度推定タスクによるマルチタスク学習を使用して、これらの感情表現の特性を学習します(図2参照)。2つのデータセット、つまり模擬した通話と実際の通話に対して行った実験の結果から、提案手法が従来の手法と比べてコールレベルとターンレベルの両方の顧客満足度推定の精度を大幅に向上させることを示しています。

図1 コールセンター通話におけるターンレベル顧客満足度とコールレベル顧客満足度

図2 提案する顧客満足度推定フレームワーク「階層的マルチタスク学習モデル」

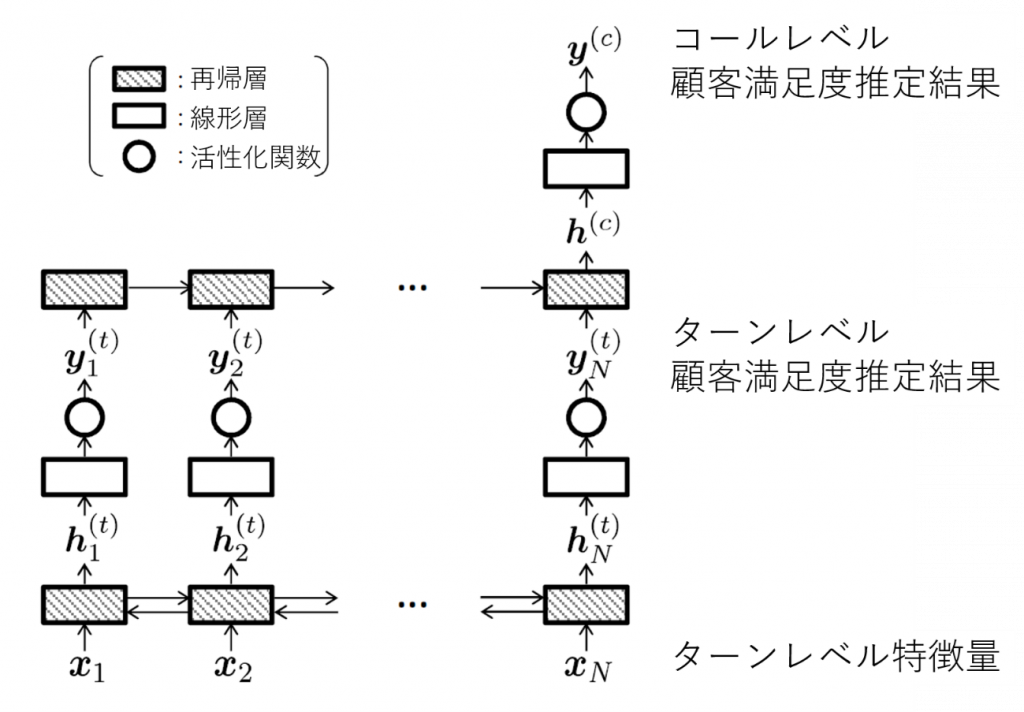

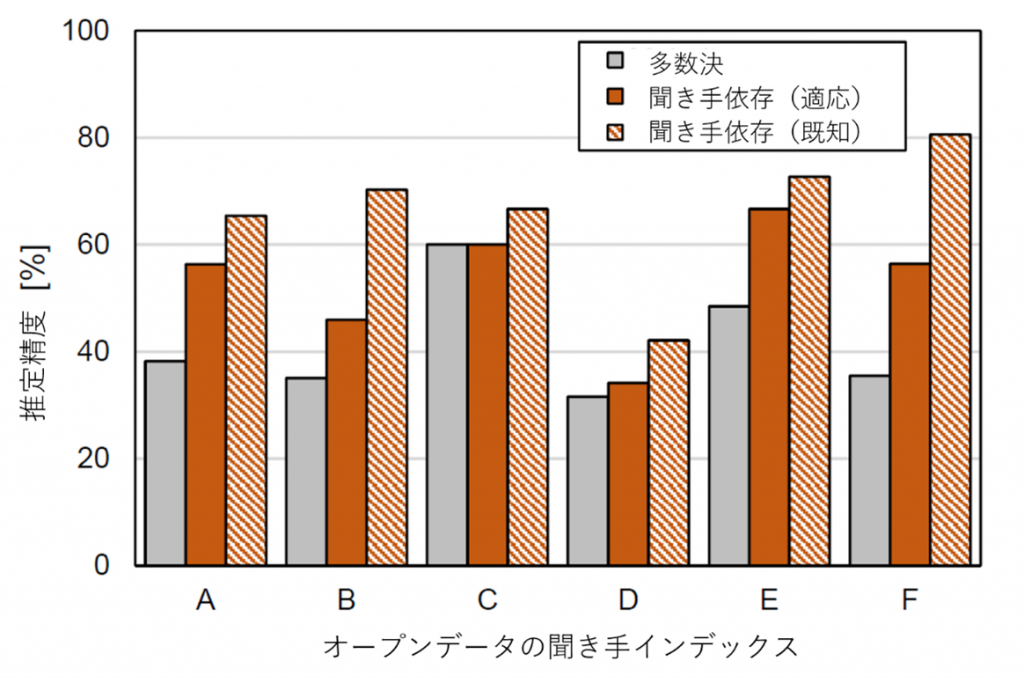

第二段階の研究では、自然な発話における4クラスの基本感情の分類に取り組みます。一つの応用例としては、感情に配慮した対話制御が挙げられます。自然な発話では感情の知覚が聞き手によって変わりますが、ほとんどの従来の方法では、この聞き手の個性を無視し、複数の聞き手の多数決のモデル化だけを行っています。これに対し、この論文では、個々の聞き手の感情認識をモデル化する新しい感情認識フレームワークを提案しています。提案手法では、個々の聞き手に対する感情認識モデル「聞き手依存モデル」を用いることで、個々の聞き手が感じる感情を推定することができますし、多数決の感情も推定することができます(図3参照)。音声処理で大成功を収めた深層学習のドメイン適応を取り入れており、新たな聞き手に対して聞き手依存モデルを適応させることも可能です。2種類のデータセットを用いた感情分類実験の結果から、提案手法が聞き手依存の感情認識の精度を大幅に向上させることを示しています(図4参照)。

図3 提案する聞き手依存感情認識モデル

図4 聞き手依存の感情推定精度

これら2つの研究は、感情情報の表現と知覚にはある一定の傾向があり、その傾向を利用することで、実環境における感情認識の精度を向上させることができることを示しています。この博士論文は、実環境での感情認識の利用に向けた技術的進展と、人間と機械との自然なコミュニケーションの実現に貢献しています。